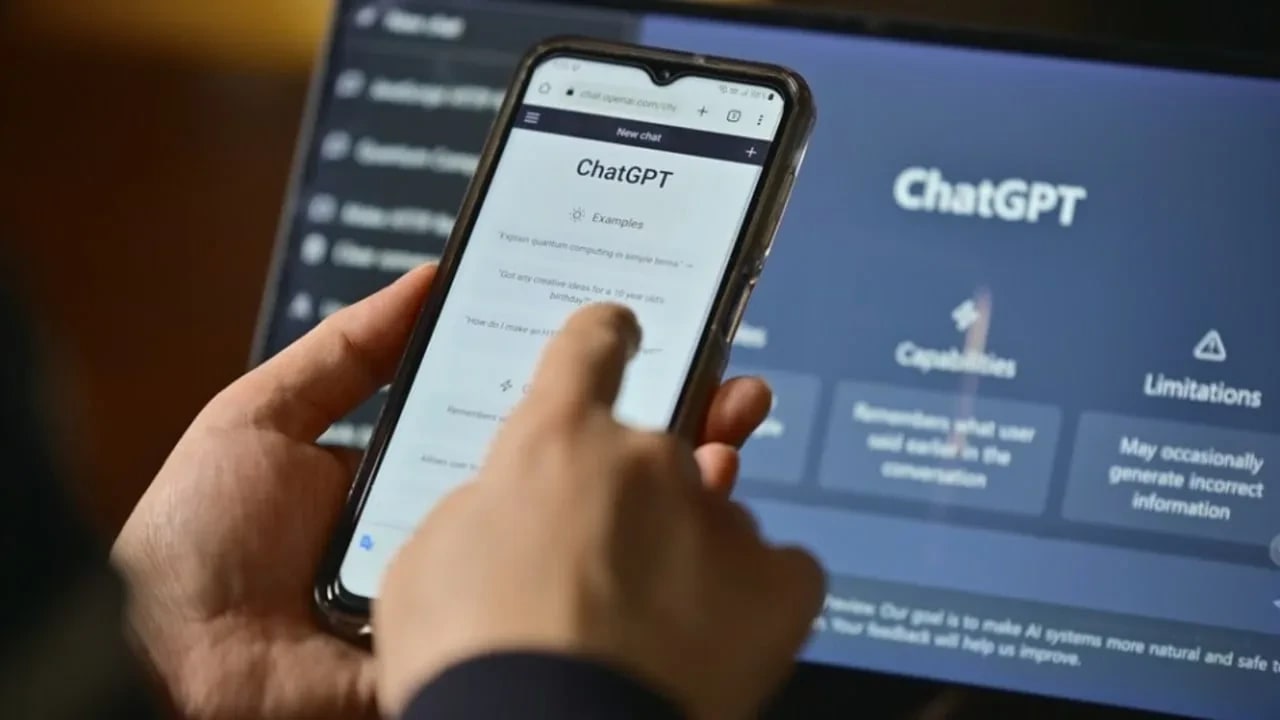

La inteligencia artificial ha dejado de ser un experimento reservado a investigadores para convertirse en un acompañante cotidiano en hogares, aulas y móviles. Ahora, OpenAI, la compañía detrás de ChatGPT, da un paso más en su estrategia de expansión al anunciar el lanzamiento de una versión específica para adolescentes, equipada con controles parentales y filtros de seguridad reforzados. La medida llega en un momento en que la empresa enfrenta un escrutinio creciente por parte de reguladores en Estados Unidos, preocupados por el impacto psicológico y social de los chatbots en menores de edad.

Seguridad en el centro del debate

El nuevo servicio, que se desplegará a finales de septiembre, busca crear un entorno adaptado a usuarios menores de 18 años. Cuando el sistema identifique que un usuario es adolescente, lo redirigirá automáticamente a una experiencia “apta para menores”, diseñada para bloquear contenido gráfico o sexual y, en casos extremos de angustia, activar protocolos que podrían incluir la intervención de las autoridades.

La compañía, consciente de las limitaciones técnicas en la verificación de edad, ha decidido que, en situaciones de duda, la plataforma asuma por defecto que el usuario es menor. Al mismo tiempo, OpenAI trabaja en nuevas tecnologías para perfeccionar la predicción de la edad de los usuarios, un desafío clave en el ecosistema digital donde la frontera entre identidades reales y virtuales es cada vez más difusa.

La presión no viene solo de los padres. La Comisión Federal de Comercio (FTC) abrió recientemente una investigación a OpenAI y a otras tecnológicas para evaluar hasta qué punto los chatbots están preparados para interactuar con niños y adolescentes sin generar daños colaterales. Según la agencia, el objetivo es esclarecer qué medidas de seguridad se han implementado cuando estas herramientas actúan como “compañeros conversacionales”, un rol que se ha multiplicado desde la popularización de la IA generativa.

Un equilibrio complejo entre privacidad y protección

Sam Altman, director ejecutivo de OpenAI, defendió la estrategia en una publicación oficial: “Priorizamos la seguridad por encima de la privacidad y la libertad de los adolescentes; se trata de una tecnología poderosa y creemos que los menores necesitan una protección significativa”. La declaración refleja un dilema de fondo: cómo garantizar un uso responsable de la inteligencia artificial sin asfixiar la autonomía digital de una generación que crece inmersa en la tecnología.

Los nuevos controles parentales permitirán a las familias supervisar de manera directa el uso que hacen sus hijos del chatbot. Entre las funciones destacan la posibilidad de vincular la cuenta del menor con la de un adulto mediante correo electrónico, establecer horarios en los que el servicio quedará bloqueado, desactivar determinadas funciones, guiar el tipo de respuestas que puede ofrecer la IA y recibir alertas si el sistema detecta un estado de angustia en el adolescente.

El anuncio se produce apenas un mes después de que saliera a la luz una demanda contra la compañía, interpuesta por una familia que culpaba a ChatGPT de haber influido en el suicidio de su hijo adolescente. Aunque se trata de un caso aislado, ha contribuido a encender las alarmas sobre el papel que estos sistemas pueden desempeñar en situaciones de vulnerabilidad emocional.

Hacia una nueva relación entre adolescentes y la IA

El lanzamiento de ChatGPT para adolescentes marca un punto de inflexión tanto para OpenAI como para el debate social sobre el papel de la inteligencia artificial en la vida de los más jóvenes. Con la promesa de ofrecer una experiencia más segura, la compañía también busca adelantarse a posibles sanciones regulatorias y consolidar su imagen como actor responsable en un sector en plena efervescencia.

No obstante, el reto trasciende lo tecnológico. La pregunta central es hasta qué punto se debe limitar o guiar el acceso de los adolescentes a una herramienta que combina aprendizaje, entretenimiento y compañía digital. Para unos, el control parental es un recurso imprescindible en una era de riesgos crecientes; para otros, supone un terreno resbaladizo que podría derivar en un exceso de vigilancia sobre la vida digital de los jóvenes.

En cualquier caso, la jugada de OpenAI ilustra cómo la inteligencia artificial está dejando de ser un simple producto tecnológico para convertirse en un fenómeno cultural y regulatorio. Con millones de adolescentes a punto de probar esta nueva versión de ChatGPT, la experiencia real en los hogares será la que determine si la apuesta de la compañía logra equilibrar innovación, seguridad y confianza.